深度解析,Spark SortBy 数据预测的精妙之道

Spark SortBy 在数据处理领域具有重要地位,其数据预测功能更是备受关注,想要深入了解 Spark SortBy 如何进行数据预测,那就跟随本文一探究竟。

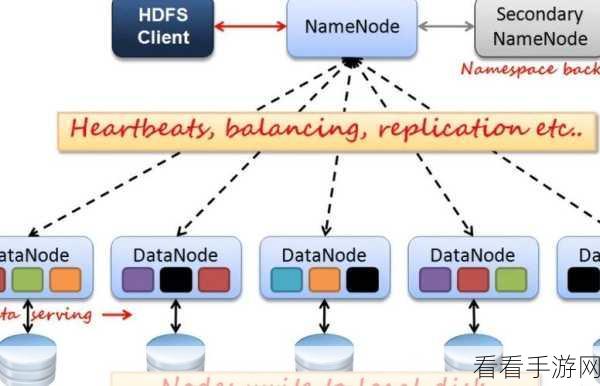

Spark SortBy 数据预测的实现,离不开对其核心原理的清晰把握,要明白 Spark 是一个强大的分布式计算框架,而 SortBy 操作则是基于特定的排序规则对数据进行重新排列,这种排序操作在数据预测中发挥着关键作用,它能够将相关的数据元素聚集在一起,为后续的分析和预测提供有序的数据基础。

数据特征的提取和选择至关重要,在进行数据预测时,需要从原始数据中提取出有价值的特征,这些特征能够反映数据的内在规律和趋势,通过合理的特征工程,可以提高预测模型的准确性和性能。

模型的选择和训练也是关键环节,针对不同的数据集和预测任务,需要选择合适的预测模型,如线性回归、决策树、神经网络等,在训练模型时,要使用有效的优化算法和超参数调整方法,以确保模型能够充分学习数据中的模式和规律。

数据的预处理和清洗也不能忽视,原始数据往往存在噪声、缺失值等问题,需要进行适当的处理和清洗,以提高数据的质量和可靠性,这包括数据的标准化、归一化、填充缺失值等操作。

对预测结果的评估和验证是必不可少的,通过使用合适的评估指标,如均方误差、准确率等,可以客观地评价预测模型的性能,并根据评估结果进行必要的调整和改进。

掌握 Spark SortBy 进行数据预测并非一蹴而就,需要综合考虑多个方面的因素,并不断进行实践和优化,希望本文能为您在探索 Spark SortBy 数据预测的道路上提供有益的指导和帮助。

参考来源:相关技术文档及专业书籍。

仅供参考,您可以根据实际需求进行调整和修改。