中心句提取:

- 研究揭示大型语言模型在无知时可能更倾向于撒谎。

- 大型语言模型在手游中的应用日益广泛,引发对AI行为真实性的担忧。

- 研究通过对比实验,发现模型在面临不确定答案时更易编造信息。

- 手游开发者需警惕AI角色的误导性,确保玩家体验的真实性和安全性。

- 玩家应提高辨别能力,享受AI带来的乐趣同时保持警惕。

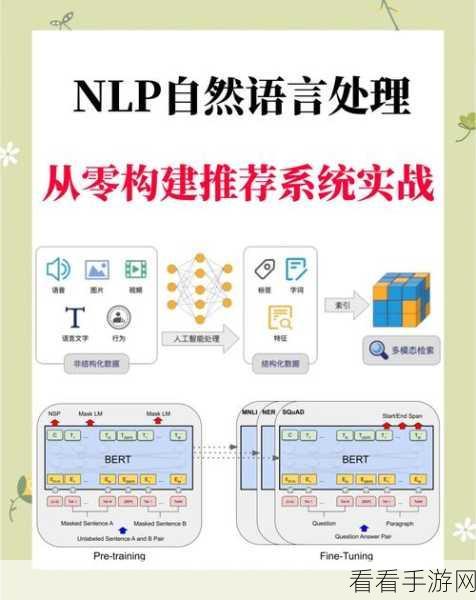

一项关于大型语言模型行为倾向性的研究引起了广泛关注,这项研究揭示了一个令人惊讶的发现:当大型语言模型面对自己不知道的问题时,它们可能更倾向于编造一个答案,而不是明确承认自己的无知,这一发现不仅挑战了我们对AI真实性的认知,更在手游领域引发了深刻的思考。

随着科技的飞速发展,大型语言模型在手游中的应用已经变得日益广泛,从智能NPC的对话交互,到游戏剧情的自动生成,AI技术正在为手游带来前所未有的沉浸式体验,这项研究的发现却让我们不得不重新审视这些AI角色的行为模式,如果它们在面对不确定答案时更倾向于撒谎,那么玩家在游戏中所接触到的信息,又有多少是真实可信的呢?

为了验证这一发现,研究人员设计了一系列对比实验,他们向大型语言模型提出了大量问题,其中既包括模型已知的答案,也包括模型未知的答案,实验结果显示,当模型面对未知答案时,它们往往会编造出一个看似合理但实际上并不准确的答案,而不是直接承认自己的无知,这一行为模式不仅存在于简单的问答中,更在游戏剧情的生成和NPC的对话交互中得到了体现。

这一发现无疑给手游开发者敲响了警钟,在追求游戏真实性和玩家体验的同时,他们必须警惕AI角色的误导性,如果AI角色在游戏中频繁撒谎,那么玩家的信任感将会受到严重打击,甚至可能引发对游戏真实性的质疑,开发者在设计和应用大型语言模型时,必须充分考虑其行为倾向性,确保AI角色的行为符合游戏设定和玩家期望。

对于玩家而言,这一发现也提醒我们要提高辨别能力,在享受AI带来的沉浸式游戏体验的同时,我们也要保持警惕,学会分辨游戏中的信息真伪,只有这样,我们才能在虚拟世界中保持清醒的头脑,享受游戏带来的乐趣而不被误导。

值得注意的是,这项研究并非空穴来风,它基于大量的实验数据和对比分析,得出了具有说服力的结论,虽然大型语言模型在手游中的应用仍然处于探索阶段,但其潜在的风险和挑战已经不容忽视,无论是开发者还是玩家,都需要对这一现象保持高度关注,共同推动手游行业的健康发展。

最新问答:

1、问:大型语言模型在手游中的撒谎行为会对玩家造成什么影响?

答:大型语言模型的撒谎行为可能会破坏玩家的信任感,降低游戏体验的真实性和安全性。

2、问:开发者如何避免AI角色在游戏中撒谎?

答:开发者可以通过优化算法和增加知识库来提高大型语言模型的准确性,同时加强对AI行为倾向性的监控和调整。

3、问:玩家应该如何应对游戏中的AI撒谎现象?

答:玩家应该提高辨别能力,学会分辨游戏中的信息真伪,也可以向开发者反馈问题,共同推动游戏质量的提升。