本文深入探讨了Anthropic研究揭示的人工智能大型语言模型在安全领域的漏洞,及其对手游行业的影响与启示。

近年来,随着人工智能技术的飞速发展,大型语言模型在游戏领域的应用日益广泛,特别是在手游智能化、个性化推荐及NPC(非玩家角色)交互等方面展现出巨大潜力,这些技术创新的背后也隐藏着不容忽视的安全风险,Anthropic公司的一项研究揭示了大型语言模型存在的安全漏洞,为手游行业敲响了警钟,该研究不仅揭示了AI模型的潜在威胁,还为手游开发者提供了宝贵的启示。

中心句:Anthropic研究发现大型语言模型易受攻击,存在数据泄露、恶意操控等风险。

Anthropic的研究团队通过一系列精心设计的实验,发现大型语言模型在接收特定类型的输入时,可能会泄露训练数据中的敏感信息,如用户隐私、游戏策略等,攻击者还能利用模型对输入的敏感性,通过精心构造的输入来操控模型的输出,从而在游戏内制造混乱,甚至影响游戏的公平性,这些漏洞的存在,无疑对手游的安全性和用户体验构成了严重威胁。

中心句:手游行业需加强AI模型的安全审计与防护,提升用户数据保护意识。

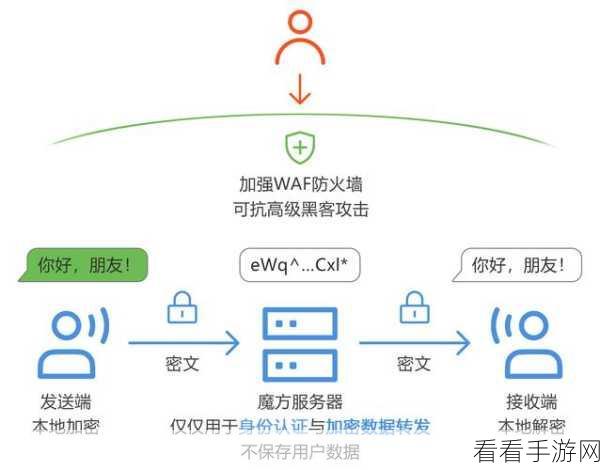

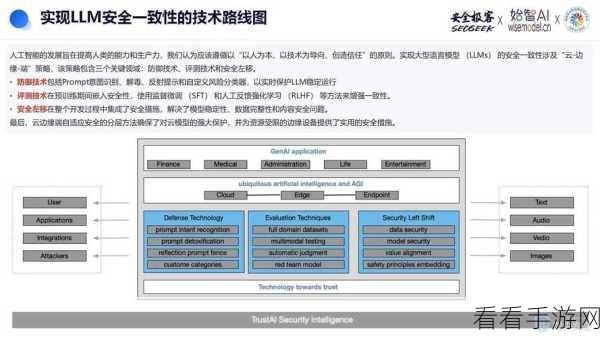

面对这一挑战,手游行业必须采取积极措施,加强AI模型的安全审计与防护,开发者应在模型训练阶段就注重数据的安全处理,避免敏感信息的泄露,通过引入对抗性训练、模型解释性增强等技术手段,提升模型对恶意输入的识别与抵御能力,加强用户数据保护意识,明确告知用户数据的使用方式及风险,是维护用户信任与游戏生态健康的关键。

中心句:AI技术在手游中的创新应用需与安全保障并重,实现可持续发展。

值得注意的是,尽管AI技术为手游带来了前所未有的创新机遇,但其安全性的提升同样不容忽视,手游开发者在探索AI技术的新应用时,应始终将安全保障放在首位,确保技术的创新与应用能够相互促进,共同推动手游行业的可持续发展,通过AI技术提升游戏的智能化水平,同时加强游戏内数据的加密与保护,确保玩家在享受游戏乐趣的同时,个人信息与游戏资产得到充分保障。

参考来源:Anthropic公司研究报告

最新问答:

1、问:大型语言模型在手游中的安全漏洞主要有哪些表现形式?

答:大型语言模型在手游中的安全漏洞主要表现为数据泄露、恶意操控及游戏内混乱等,攻击者可能通过特定输入获取敏感信息,或操控模型输出影响游戏公平性。

2、问:手游开发者应如何加强AI模型的安全防护?

答:手游开发者应加强AI模型的安全审计,注重数据的安全处理,并引入对抗性训练等技术手段提升模型对恶意输入的识别能力,加强用户数据保护意识,确保用户信息的安全。

3、问:AI技术在手游中的创新应用与安全保障如何平衡?

答:AI技术在手游中的创新应用与安全保障应并重,开发者在探索新技术时,应始终将安全保障放在首位,确保技术的创新与应用能够相互促进,共同推动手游行业的可持续发展。